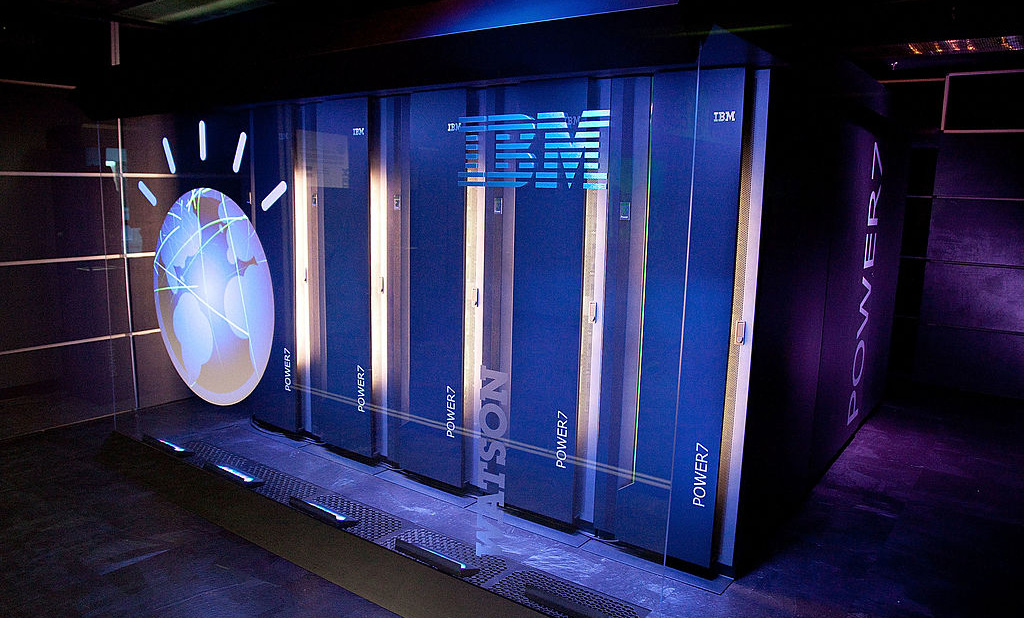

Supercomputer Watson van techgigant IBM werd in 2011 in één klap wereldberoemd toen het de Amerikaanse tv-quiz Jeopardy! won tegen twee topkandidaten. De IBM-aandelen schoten omhoog. Ceo Ginni Rometty kondigde vol bravoure aan dat Watson voor een revolutie zou zorgen in de medische en financiële wereld en spionage.

Niet lang daarna werd de toepassing ‘Watson for Oncology’ gepresenteerd die op basis van medische big data de beste diagnose en het meest persoonlijke behandelplan zou maken voor de patiënt. Gerenommeerde klinieken als het MD Anderson Center in Texas vielen voor het verhaal en kochten het systeem voor 62 miljoen dollar. Media speculeerden over het einde van het beroep arts.

Toch moesten de medici niet lang daarna vaststellen dat Watson onjuiste behandeltrajecten voorstelde die het leven van patiënten zelfs in gevaar brachten. Bij nader inzien bleek artificial intelligence toch niet staat om een menselijke arts te vervangen. Het niveau van Watson was niet hoger dan een eerstejaars student medicijnen.

Na diverse vergeefse pogingen om het systeem te verbeteren, werd de afdeling Watson Health in januari 2022 stilletjes door IBM verkocht.

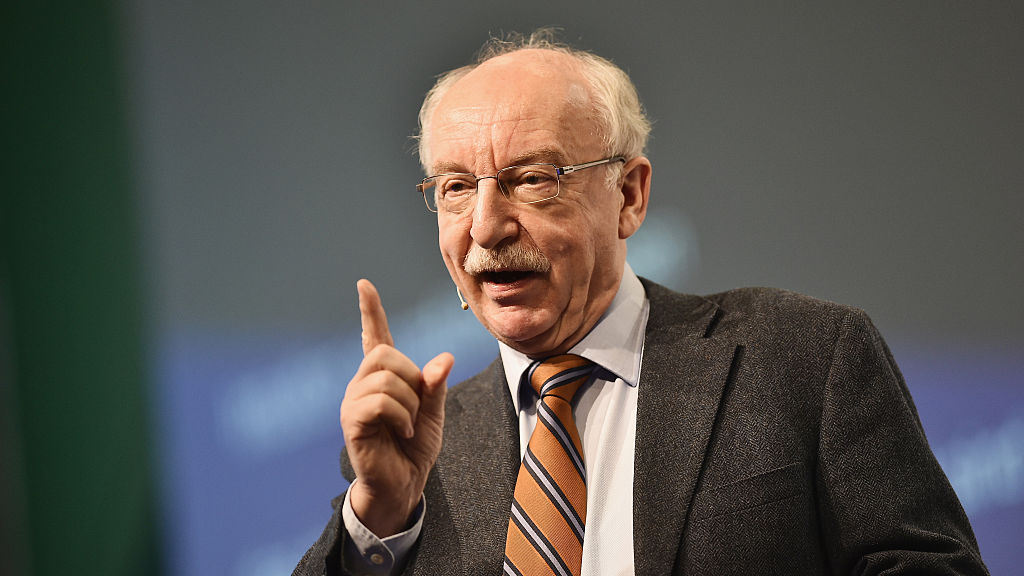

Gerd Gigerenzer onderzoekt besluitvorming

Deze anekdote over de neiging van mensen om bijna bovennatuurlijke eigenschappen toe te schrijven aan kunstmatige intelligentie komt uit het boek How to Stay Smart in a Smart World: Why Human Intelligence Still Beats Algorithms van de Duitse psycholoog Gerd Gigerenzer (1947).

De directeur van het Harding-Zentrum für Riskokompetenz bij de universiteit van Potsdam is voormalig directeur van het Max-Planck-Institut für Bildungsforschung in Potsdam en professor voor psychologie aan de University of Chicago. Hij schreef verschillende boeken over heuristiek en besluitvorming voor managers, waaronder Adaptive Thinking en Rationality for Mortals.

Gigerenzer doet al decennialang onderzoek naar besluitvorming bij onzekere omstandigheden. Hij houdt met zijn nieuwste boek een sterk pleidooi voor het blijvende belang van het menselijk onderscheidingsvermogen in een geautomatiseerde wereld.

De psycholoog maakt hiervoor een sterkte-zwakte-analyse van zowel het brein als de duizelingwekkende rekenkracht van kunstmatige intelligentie. ‘Juist door de technische ontwikkelingen moeten we onze hersenen meer gebruiken dan ooit.’

Bouwen aan een alwetend systeem

De stille afgang van supercomputer Watson is één van de vele praktijksituaties waar Gigerenzer afweegt of de inzet van kunstmatige intelligentie wel zin heeft. ‘Als manager moet je weten of het AI-systeem echt doet wat wordt beloofd, of dat het vooral een mooi marketingpraatje is.’

Een van de grote misvattingen over kunstmatige intelligentie is volgens de professor dat de ontwikkelaars van algoritmes en deep learning werken aan een alwetend systeem. Dat systeem kiest je ideale liefdespartner of plant wanneer het de juiste tijd is om kinderen te krijgen. Of een sociaal werker krijgt via AI signalen binnen en maakt een afspraak met je kind voordat je wist dat het depressief was.

Maar AI kan juist veel dingen niet, zegt Gigerenzer. Hij betoogt dat je moet snappen waar algoritmes in uitblinken en waar het altijd tekort zal schieten vergeleken met menselijke intelligentie.

Waar kunstmatige intelligentie goed in is

AI levert de beste resultaten op in een ‘stabiele wereld’ waarin er weinig verandert. ‘Complexe algoritmes werken het beste in goed gedefinieerde, stabiele situaties waar grote aantallen data beschikbaar zijn. Een goed geprogrammeerde schaakcomputer zal daarom altijd winnen van de grootmeester.’

Heel anders is het wanneer de omstandigheden onzeker zijn, zoals op straat waar een klein kind zomaar tussen geparkeerde auto’s tevoorschijn kan springen. ‘Daarom zullen volledig autonoom rijdende auto’s (level 5) nooit in elke omgeving zonder menselijk toezicht kunnen rijden, ook al hoor je die belofte wel.’

In de praktijk betekent dit dat Watson in een spelletjesshow superieur is, maar dat een kankertherapie te veel onzekerheden bevat, waar een mens betere besluiten neemt dan een algoritme, zegt de professor. ‘Als de ceo’s van deze ziekenhuizen het ‘stabiele-wereld-principe’ snapten, hadden ze hier nooit miljoenen dollars in gestoken.’

Machine kan niet causaal denken

Met het slimmer worden van de techniek, moeten mensen ook slimmer worden. Bij die basiskennis hoort het snappen wat een computer kan. ‘Dat is razendsnel rekenen, associaties vinden in big data en het herkennen van patronen in afbeeldingen of akoestische informatie.’

Op die drie terreinen wordt de computer steeds beter, zeker als de rekensnelheid om de zoveel jaar verdubbelt. ‘Maar een machine lukt het voorlopig niet om bijvoorbeeld causaal denken, intuïtieve psychologie, begrip van ruimte en tijd, en bewustzijn te kopiëren naar een softwaresysteem.’

Gigerenzer noemt het common sense, de optelsom van gedeelde kennis die een kind leert. ‘Dat kunnen we een computer niet leren en zeker niet via deep learning. Want dat werkt alleen in een stabiele omgeving.’

Mensen inzetten waar ze het beste in zijn

Wanneer een grootmeester het aflegt tegen een schaakcomputer, dan maakt Gigerenzer zich dus geen zorgen over dat algoritmes de wereld overnemen van de mens.

‘Onze hersenen hebben miljoenen jaren evolutie achter de rug en zijn juist erg goed om met onzekerheden om te gaan, ongeacht of er veel of weinig informatie beschikbaar is. We weten niet hoe je dat in een computer krijgt. Een schaakcomputer heeft er bijvoorbeeld geen idee van dat hij aan het schaken is.’

De bewustwording over de kracht en zwaktes van mensen en computers is voor Gigerenzer de eerste stap om slimmer te opereren in een wereld waar alles ‘smart’ wordt. ‘We moeten kunstmatige intelligentie laten doen waar het goed in is en mensen inzetten waar wij het beste in zijn.’

Een computer kan onze kinderen niet opvoeden, vindt niet de liefde van ons leven en is niet in staat om de wereldmacht over te nemen, zegt hij. ‘In onzekere situaties heb je zowel menselijk beoordelingsvermogen en transparantie nodig.’

Transparante algoritmen voorkomen mythevorming

Het boek staat vol met voorbeelden hoe te complexe algoritmen bijdragen aan de mythevorming over de superioriteit van kunstmatige intelligentie. En dat mensen zodra ze het niet meer doorgronden, bijna hogere machten toeschrijven aan kunstmatige intelligentie.

Dit is te voorkomen door algoritmes simpel en transparant te houden, zegt Gigerenzer. ‘Talloze onderzoeken wijzen uit dat simpele algoritmes waarbij we precies snappen wat het meet, minstens zo doeltreffend zijn als systemen die zijn opgebouwd uit miljoenen datapunten. Meer data levert niet per se betere resultaten op. Maak inzichtelijk wat je meet.’

Als adviseur van de Duitse regering probeert hij de politiek wakker te schudden dat mensen ook smart moeten worden. Dat geldt ook voor journalisten. Uit recent onderzoek in het Verenigd Koninkrijk blijkt dat media in 60 procent van de gevallen braaf de reclameclaims van fabrikanten bijna klakkeloos herhalen. ‘Een vergelijkbare tendens zie ik in andere landen.’

De Watson-computer van IBM is daarin een goed voorbeeld, zegt hij. ‘Door de hele media was terug te lezen dat Watson voor een medische revolutie zou zorgen. Dat het niet meer lang zou duren voordat artsen hun baan zouden verliezen. Dat Watson nu verkocht is, lees je op veel minder plekken.’

Mens en kunstmatige intelligentie in balans

Gigerenzer in geïnteresseerd in de vraag hoe kunstmatige intelligentie en de mens weer beter met elkaar in balans komen. Daarom ontwikkelt hij samen met Stanford University een methode om jonge digital natives te leren hoe ze beter met techniek kunnen omgaan. ‘Dus hoe je een website analyseert, hoe je feiten van fake news onderscheidt.’

In zijn strijd voor meer transparantie in de digitale wereld noemt hij het accepteren van cookies op een website een voorbeeld van een stap in de juiste richting. Maar dan moet je het wel goed uitvoeren, zegt hij. ‘Dus je bezoeker niet opzadelen met een lange tekst en de knop ‘accepteren’, maar duidelijke opties waarbij je per stuk kunt aangeven wat je accepteert en wat niet.’

De balans tussen de mens en de ‘smart’ wereld is een vertrouwenskwestie, aldus de psycholoog. ‘Het internet was ooit bedoeld als de poort naar het informatietijdperk. Nu leven we in tijden van zowel informatie als desinformatie.’

Die desinformatie ziet Gerd Gigerenzer als een bedreiging voor de menselijke evolutie, omdat het ons vertrouwen doet afbrokkelen in instituties die juist gebouwd zijn voor een betere samenleving. Denk aan de overheid, wetenschap, onderzoeksjournalistiek en justitie. ‘We moeten het internet repareren. Dat betekent bijvoorbeeld dat we een einde moeten maken aan verdienmodellen die gebouwd zijn op surveillance. We moeten werken aan digitale technologie waarop we kunnen vertrouwen, omdat we het snappen.’

How to Stay Smart in a Smart World: Why Human Intelligence Still Beats Algorithms is geschreven door psycholoog Gerd Gigerenzer. Het boek is onder meer te bestellen bij managementboek.nl.

How to Stay Smart in a Smart World: Why Human Intelligence Still Beats Algorithms is geschreven door psycholoog Gerd Gigerenzer. Het boek is onder meer te bestellen bij managementboek.nl.

Lees meer over kunstmatige intelligentie:

- Dit is de superkracht van de mens in een tijdperk vol artificiële intelligentie

- Kun je een betere leider worden met AI?

- Deze strategische stappen zijn nodig om te groeien met kunstmatige intelligentie